概率论辅导讲义

前言

概率论是研究随机现象数量规律的数学分支,它不仅是许多高级学科(如统计学、机器学习、金融工程)的基石,也是我们理解和量化世界不确定性的一种强大工具,本讲义将带你从零开始,逐步构建概率论的知识框架。

第一部分:基本概念与概率计算

随机试验与样本空间

- 随机试验: 一个可以在相同条件下重复进行,且每次试验的结果不确定,但所有可能结果是已知的试验。

掷一枚硬币、掷一个骰子、抽取一张扑克牌。

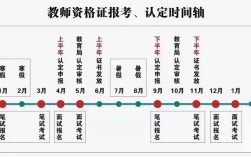

(图片来源网络,侵删)

(图片来源网络,侵删) - 样本空间: 一个随机试验所有可能结果组成的集合,通常记为 S 或 。

- 掷硬币:S = {正面, 反面}

- 掷骰子:S = {1, 2, 3, 4, 5, 6}

- 样本点: 样本空间中的每一个元素,即一个基本结果。

- 事件: 样本空间的一个子集,由一个或多个样本点组成,是随机试验中我们关心的事情。

- 掷骰子事件 A = "点数为偶数" = {2, 4, 6}

- 掷骰子事件 B = "点数大于 4" = {5, 6}

概率的定义与计算

概率是衡量事件发生可能性大小的数值,记为 P(A)。

-

概率的公理化定义 (Kolmogorov 公理):

- 非负性: 对于任意事件 A,有

0 ≤ P(A) ≤ 1。 - 规范性: 必然事件(整个样本空间 S)的概率为 1,即

P(S) = 1。 - 可列可加性: 对于两两互斥的事件 A₁, A₂, ...,有

P(A₁ ∪ A₂ ∪ ...) = P(A₁) + P(A₂) + ...。

- 非负性: 对于任意事件 A,有

-

计算方法:

-

古典概型: 当试验结果有限且等可能时。

(图片来源网络,侵删)

(图片来源网络,侵删)- 公式:

P(A) = (事件 A 包含的样本点数) / (样本空间的总样本点数) - 例子: 从一副 52 张扑克牌中随机抽取一张,抽到 K 的概率是多少?

- 事件 A = "抽到 K",包含 4 个样本点(K♠, K♥, K♦, K♣)。

- 样本空间 S 总共有 52 个样本点。

- P(A) = 4 / 52 = 1/13。

- 公式:

-

几何概型: 当试验结果无限且等可能时(通常与面积、体积、长度有关)。

- 公式:

P(A) = (构成事件 A 的区域度量) / (样本空间的总区域度量) - 例子: 在一个单位正方形内随机取一个点,求该点到正方形中心的距离小于 0.5 的概率。

- 事件 A 的区域是以中心为圆心,半径为 0.5 的圆,面积为

π * (0.5)² = π/4。 - 样本空间的总面积为 1。

- P(A) = (π/4) / 1 = π/4。

- 事件 A 的区域是以中心为圆心,半径为 0.5 的圆,面积为

- 公式:

-

概率的基本性质与公式

-

事件的运算:

- 补事件: A 不发生,记为

Aᶜ或A'。P(Aᶜ) = 1 - P(A)。 - 并事件: A 或 B 发生,记为

A ∪ B。 - 交事件: A 和 B 同时发生,记为

A ∩ B或AB。 - 互斥事件: A 和 B 不能同时发生,即

A ∩ B = ∅(空集)。P(A ∪ B) = P(A) + P(B)。 - 独立事件: A 的发生与否不影响 B 发生的概率。

P(A ∩ B) = P(A) * P(B)。

- 补事件: A 不发生,记为

-

重要公式:

- 加法公式:

P(A ∪ B) = P(A) + P(B) - P(A ∩ B)- 推广 (三个事件):

P(A ∪ B ∪ C) = P(A) + P(B) + P(C) - P(AB) - P(AC) - P(BC) + P(ABC)

- 推广 (三个事件):

- 条件概率: 在事件 B 已经发生的条件下,事件 A 发生的概率,记为

P(A|B)。- 公式:

P(A|B) = P(A ∩ B) / P(B)(要求P(B) > 0)

- 公式:

- 乘法公式:

P(A ∩ B) = P(A) * P(B|A) = P(B) * P(A|B)- 推广 (多个事件):

P(A₁ ∩ A₂ ∩ ... ∩ Aₙ) = P(A₁) * P(A₂|A₁) * ... * P(Aₙ|A₁∩...∩Aₙ₋₁)

- 推广 (多个事件):

- 全概率公式: 如果事件 B₁, B₂, ..., Bₙ 构成一个完备事件组(即它们互斥且并集为 S),那么对任意事件 A:

- 公式:

P(A) = Σ P(Bᵢ) * P(A|Bᵢ)(i 从 1 到 n) - 思想: 将复杂事件 A 的概率,分解为在不同原因 Bᵢ 下发生的概率之和。

- 公式:

- 贝叶斯公式: 在已知事件 A 发生的条件下,反推某个原因 Bᵢ 发生的概率。

- 公式:

P(Bᵢ|A) = [P(Bᵢ) * P(A|Bᵢ)] / P(A) = [P(Bᵢ) * P(A|Bᵢ)] / [Σ P(Bⱼ) * P(A|Bⱼ)](j 从 1 到 n) - 思想: “由果溯因”,是全概率公式的逆应用。

- 公式:

- 加法公式:

第二部分:随机变量及其分布

随机变量

将随机试验的每一个结果用一个数值来表示的函数,记为 X。

- 离散型随机变量: 取值有限或可列无限个数值。

掷骰子的点数 X,取值为 {1, 2, 3, 4, 5, 6}。

- 连续型随机变量: 取值充满某个区间或整个实数轴。

灯泡的寿命 X,取值为 (0, +∞)。

离散型随机变量的分布

- 概率质量函数: 描述离散型随机变量取各个值的概率,记为

p(x) = P(X = x)。- 性质:

p(x) ≥ 0且Σ p(x) = 1(对所有可能的 x 求和)。

- 性质:

- 累积分布函数: 描述随机变量 X 小于或等于某个值 x 的概率,记为

F(x) = P(X ≤ x)。- 性质:

F(x)是非减函数,lim(x→-∞) F(x) = 0,lim(x→+∞) F(x) = 1。

- 性质:

连续型随机变量的分布

- 概率密度函数: 描述连续型随机变量在某个区间内取值的“密集程度”,记为

f(x)。- 重要性质:

f(x) ≥ 0。∫(-∞ to +∞) f(x) dx = 1(曲线下的总面积为 1)。P(a < X ≤ b) = ∫(a to b) f(x) dx(事件概率等于密度函数在区间上的积分)。P(X = c) = 0(单点概率为 0)。

- 重要性质:

- 累积分布函数:

F(x) = P(X ≤ x) = ∫(-∞ to x) f(t) dt。- 密度函数是累积分布函数的导数:

f(x) = dF(x)/dx。

- 密度函数是累积分布函数的导数:

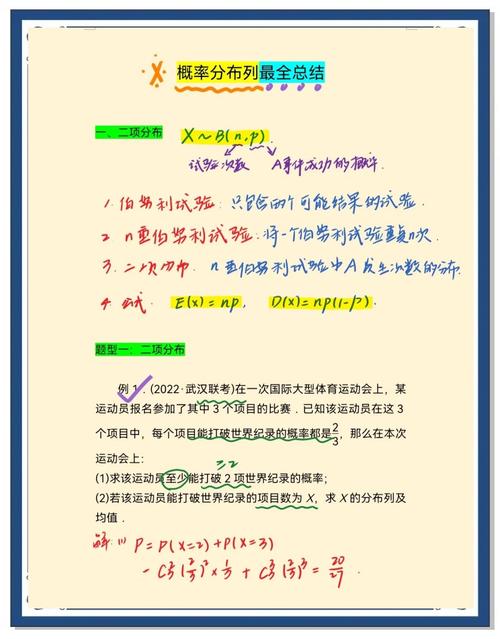

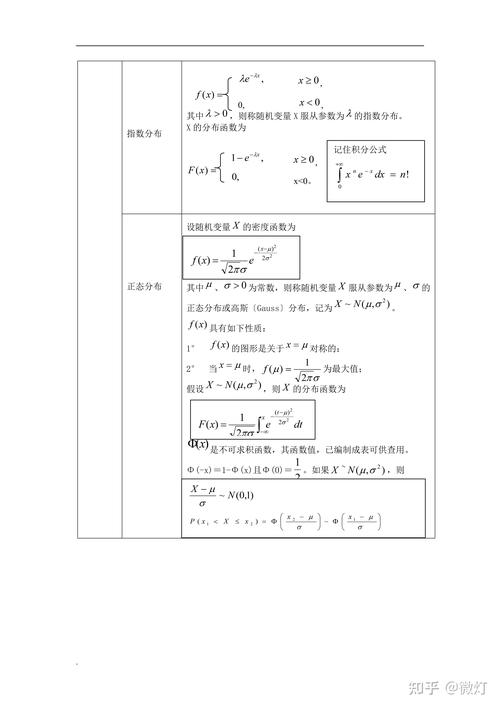

重要概率分布

| 分布名称 | 类型 | 参数 | 概率质量/密度函数 | 期望 | 方差 |

|---|---|---|---|---|---|

| 伯努利分布 | 离散 | p (成功概率) |

P(X=1)=p, P(X=0)=1-p |

p |

p(1-p) |

| 二项分布 | 离散 | n (试验次数), p (成功概率) |

P(X=k) = C(n,k) * p^k * (1-p)^(n-k) |

np |

np(1-p) |

| 泊松分布 | 离散 | (单位时间/空间内平均发生次数) | P(X=k) = (λ^k * e^(-λ)) / k! |

||

| 均匀分布 | 连续 | a, b (区间端点) |

f(x) = 1/(b-a) (当 a≤x≤b) |

(a+b)/2 |

(b-a)²/12 |

| 正态分布 | 连续 | (均值), (方差) | f(x) = (1/√(2πσ²)) * e^(-(x-μ)²/(2σ²)) |

||

| 指数分布 | 连续 | (失效率) | f(x) = λe^(-λx) (当 x≥0) |

1/λ |

1/λ² |

分布要点:

- 伯努利分布: 单次试验(成功/失败)。

- 二项分布:

n次独立重复的伯努利试验中成功的总次数。 - 泊松分布: 常用于描述单位时间/空间内稀有事件(如电话呼叫、网站点击)的发生次数,当

n很大,p很小,np适中时,二项分布可用泊松分布近似。 - 正态分布: 自然界中最常见的分布,也称为高斯分布,其分布曲线呈“钟形”。中心极限定理是其核心:大量独立随机变量的和近似服从正态分布。

- 标准正态分布: 均值

μ=0,方差σ²=1的正态分布,记为N(0, 1),任何正态分布都可以通过标准化Z = (X - μ) / σ转换为标准正态分布。

- 标准正态分布: 均值

第三部分:数字特征

数字特征是描述随机变量统计特性的几个关键数值。

期望

- 定义: 随机变量在概率意义下的“平均取值”,也称为均值或期望值,记为 E(X) 或 。

- 计算:

- 离散型:

E(X) = Σ [x * p(x)] - 连续型:

E(X) = ∫(-∞ to +∞) [x * f(x)] dx

- 离散型:

- 线性期望性质:

E(aX + b) = aE(X) + b,这个性质非常强大,即使 X 和 Y 不独立,也有E(X+Y) = E(X) + E(Y)。

方差与标准差

- 方差: 描述随机变量取值与其期望的偏离程度(离散程度),记为 Var(X) 或 。

- 定义:

Var(X) = E[(X - E(X))²] - 计算公式:

Var(X) = E(X²) - [E(X)]²(通常用这个公式计算更方便)

- 定义:

- 标准差: 方差的算术平方根,记为 ,它和方差一样,都用来衡量离散程度,但单位和原数据一致,更易于解释。

- 性质:

Var(aX + b) = a²Var(X)- 若 X 和 Y 独立,则

Var(X+Y) = Var(X) + Var(Y),若不独立,则需加上协方差项。

其他数字特征

- 协方差: 衡量两个随机变量 X 和 Y 之间的线性关系强度和方向。

- 定义:

Cov(X, Y) = E[(X - E(X))(Y - E(Y))] = E(XY) - E(X)E(Y) Cov(X, Y) > 0: 正相关(X 增,Y 倾向于增)Cov(X, Y) < 0: 负相关(X 增,Y 倾向于减)Cov(X, Y) = 0: 不相关(无线性关系,但可能存在非线性关系)

- 定义:

- 相关系数: 将协方差标准化,使其值在 [-1, 1] 之间,消除了量纲的影响。

- 定义:

ρ(X, Y) = Cov(X, Y) / (σ_X * σ_Y) |ρ| = 1: 完全线性相关ρ = 0: 不相关- 越接近 1,线性关系越强。

- 定义:

第四部分:大数定律与中心极限定理

这是连接概率论与数理统计的桥梁,是统计推断的理论基础。

大数定律

- 在大量重复试验中,事件的频率

n_A/n依概率收敛于它的概率p。 - 通俗理解: 当试验次数足够多时,频率会稳定在概率附近,这为我们用频率去估计概率提供了理论依据。

- 形式: 设

X₁, X₂, ...是独立同分布的随机变量序列,且E(Xᵢ) = μ,则对任意ε > 0,有lim(n→∞) P(|(X₁+...+Xₙ)/n - μ| > ε) = 0。

中心极限定理

- 大量独立随机变量的和(或均值)的分布,会趋向于正态分布,而不管这些随机变量本身服从什么分布。

- 通俗理解: 许多微小的、独立的随机因素叠加在一起,其总效果就近似服从正态分布,这解释了为什么正态分布无处不在。

- 林德伯格-列维中心极限定理 (最常用):

- 设

X₁, X₂, ...是独立同分布的随机变量序列,且E(Xᵢ) = μ,Var(Xᵢ) = σ² > 0。 - 令

Sₙ = X₁ + ... + Xₙ,则当n很大时,Sₙ近似服从正态分布N(nμ, nσ²)。 - 标准化形式:

(Sₙ - nμ) / (σ√n)近似服从标准正态分布N(0, 1)。 - 应用: 在

n很大时,我们可以用正态分布来近似计算独立同分布随机变量和的概率。

- 设

第五部分:实际应用与解题技巧

解题步骤

- 理解题意: 明确试验是什么,样本空间是什么。

- 识别事件: 明确要求概率的事件 A 是什么。

- 选择模型:

- 是古典概型还是几何概型?

- 是否涉及条件概率?用条件概率、乘法公式、全概率公式还是贝叶斯公式?

- 是否可以看作某个已知的分布(如二项分布、泊松分布)?

- 列出公式: 根据所选模型,写出对应的概率计算公式。

- 代入计算: 仔细计算,得出最终结果。

常见陷阱与注意事项

- 互斥 vs 独立:

- 互斥:不能同时发生。

- 独立:一个发生与否不影响另一个。

- 关键点: P(A) > 0 且 P(B) > 0,则 A 和 B 互斥时一定不独立,反之亦然。

- 条件概率 vs 联合概率:

P(A|B)是在 B 发生的前提下 A 的概率;P(A ∩ B)是 A 和 B 同时发生的概率。 - 分布的适用条件:

- 二项分布要求“

n次独立试验,每次成功概率为p”。 - 泊松分布要求“单位时间内稀有事件发生的次数”。

- 正态分布是连续分布,计算概率时要使用积分。

- 二项分布要求“

- 中心极限定理的应用: 注意判断

n是否“足够大”,n > 30就可以认为近似效果不错,使用时一定要进行标准化。